聚焦:“AI换脸”骗局来了!真实案例曝光!

俗话说

耳听为虚,眼见为实

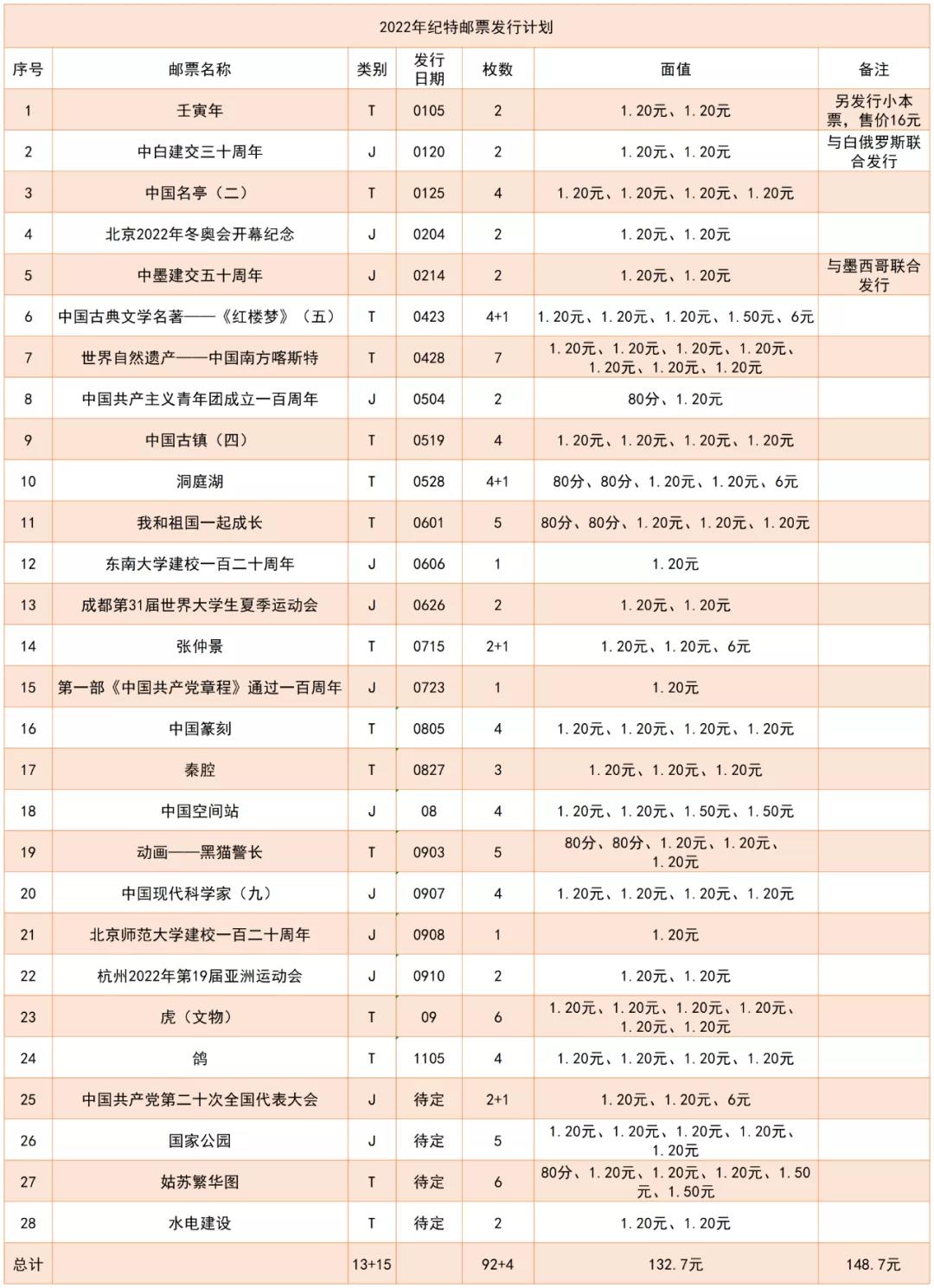

(相关资料图)

(相关资料图)

但是近日临沭警方

接到张先生报警的这件事

居然“眼见”也为假

“他先给我打了视频电话,确实是他本人。”

5月23日上午11点左右,临沭县张先生收到了自称是有过交集的“熟人”的微信好友添加申请,张先生通过其好友申请后,对方打来了视频电话,视频画面中看起来对方在说话,但是张先生这边却听不到声音。

很快对方将视频电话挂断,称信号不好,发来一张图片让张先生添加他的QQ账号(实际为群聊)。张先生按“熟人”提供的账号加入群聊后,“熟人”先是进行了寒暄,并希望第二天能安排时间面谈。正在张先生心存感激表示感谢“熟人”关心的时候,对方提出来有个事需要张先生帮忙处理。

“熟人”说,自己现在走不开,希望张先生能帮个忙。“熟人”先转一笔钱给张先生,经由张先生再转给他的朋友,这样方便他日后收回。因为刚刚通过视频电话,并且对方提出来第二天还要见面谈事情,张先生没有想太多,就一口答应了,并问他具体需要自己做些什么。

“熟人”向张先生要了银行卡账号和开户名,随后发给张先生一张转账22万的账单截图。“ 已经转过去了,收到没?”“熟人”问张先生。张先生表示还没有收到到账提示。“我这边显示到你账上了,刚才忘记点加急,可能要24小时才可以到。”“熟人”希望张先生先垫付,等他的“转账”到账后再扣除。

张先生不疑有他,到附近银行将手头上现有的10万元转到了相应账户里,并回复说已实时到账。当张先生从银行出来收到对方回复的时候,突然反应过来事情不太对劲,通过电话核实,张先生发现自己果然被骗了!

AI技术如何介入新骗局?

有什么新的诈骗方式?

注意了

1

声音合成

骗子通过骚扰电话录音等来提取某人声音,获取素材后进行声音合成,从而可以用伪造的声音骗过对方。

2

AI换脸

人脸效果更易取得对方信任,骗子用AI技术换脸,可以伪装成任何人,再通过视频方式进行信息确认。骗子首先分析公众发布在网上的各类信息,根据所要实施的骗术,通过AI技术筛选目标人群。在视频通话中利用AI换脸,骗取信任。

3

转发微信语音

除了AI换脸、合成语音外,还有一些诈骗手段也可谓防不胜防,就在前不久就有骗子通过转发微信语音的方式行骗。

在盗取微信号后,骗子便向其好友“借钱”,为取得对方的信任,他们会转发之前的语音,进而骗取钱款。尽管微信没有语音转发功能,但他们通过提取语音文件或安装非官方版本(插件),可实现语音转发。

4

通过AI技术筛选受骗人群

骗子不是漫无目的地全面撒网,而是别有用心地锁定特定对象。他们会根据所要实施的骗术对人群进行筛选,从而选出目标对象。

例如,当进行金融诈骗时,经常搜集投资信息的小伙伴会成为他们潜在的目标。

警方提示

针对花样翻新的智能AI诈骗

公众要提高防范意识

1. 不轻易提供人脸、指纹等个人生物信息给他人,不过度公开或分享动图、视频等;

2. 网络转账前要通过电话等多种沟通渠道核验对方身份,一旦发现风险,及时报警求助;

3. 如果有人自称“熟人”“领导”通过社交软件、短信以各种理由诱导你汇款,务必通过电话、见面等途径核实确认,不要未经核实随意转账汇款,不要轻易透露自己的身份证、银行卡、验证码等信息;

4. 如不慎被骗或遇可疑情形,请注意保护证据立即拨打96110报警。

关键词:

2023-07-02 14:41:07

资讯

品牌